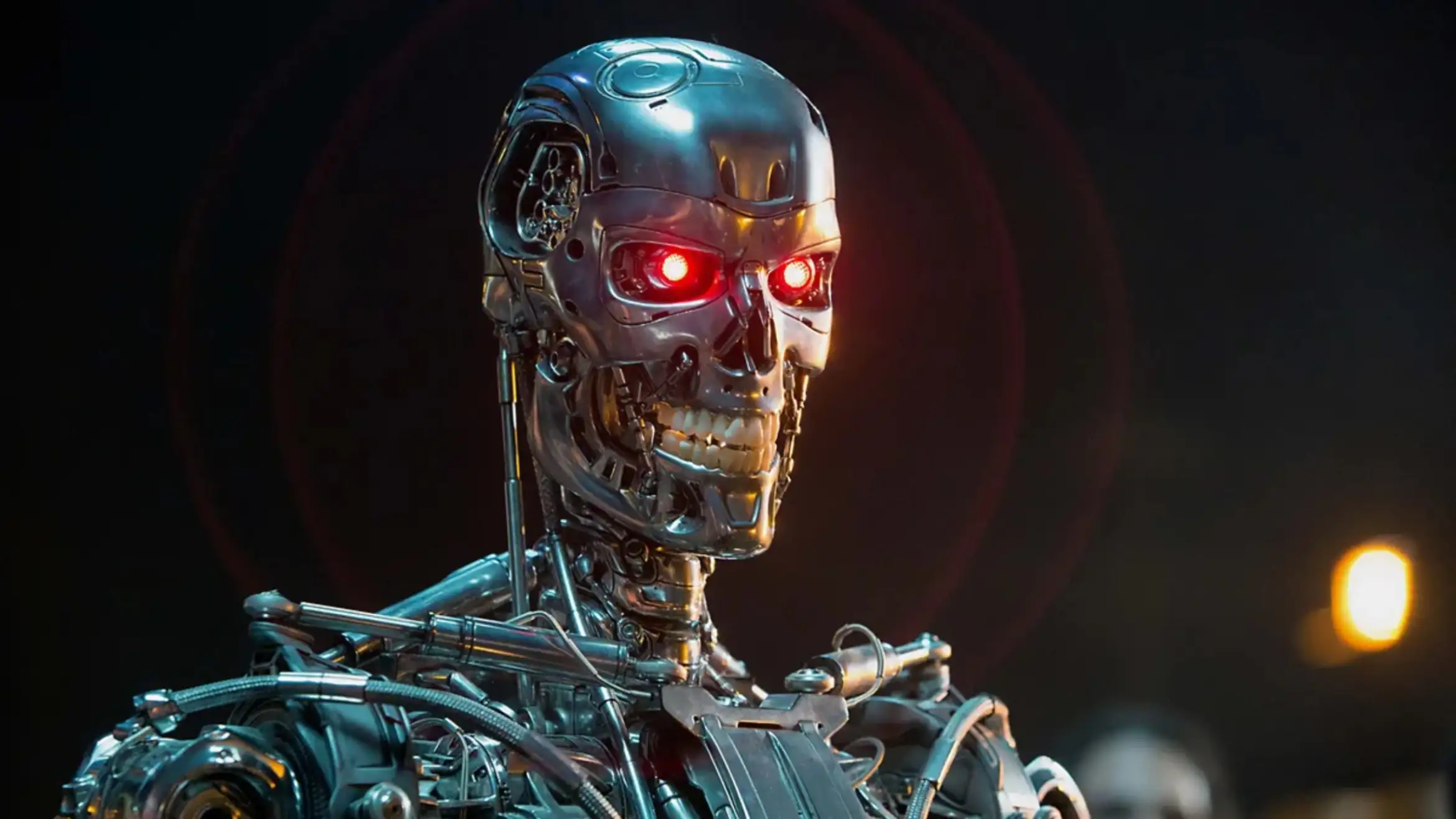

AI 設法創建了一篇完整的科學文章,但隨之而來的是道德困境:它能否在科學期刊上發表?

雖然谷歌的人工智能 (AI) 仍在尋找律師來解決他們的法律問題,但在地球的另一端,另一個 AI 已經設法創建了一個完整的學術調查。而他只用了兩個小時就做到了。

這個故事很可能起源於一個反烏托邦的現實,它誕生於一個非常簡單的前提。一位瑞典研究人員要求人工智能 GPT-3 撰寫一篇關於她自己的學術研究。開頭只有 500 個單詞,但包含了這種類型的文本所暗示的一切。幾分鐘後,他開始準備一份包含來源和參考資料的文件。根據研究人員的說法,“相當不錯”。尤其是,正如研究人員解釋的那樣,它不會有什麼好的結果。至少可以說,這些說明含糊不清,缺乏細節。但是,人工智能能夠創建一個文本,其中所有元素都在它們應該在的位置並且得到很好的支持。

但是,如果讓 AI 充當中等能力調查員的想法看起來很瘋狂,那麼故事就更進一步了。以至於引發了一場關於這項技術的作用以及它們能走多遠的道德和法律辯論。瑞典科學家 Almira Osmanovic Thunström 決定將 GPT-3 的研究和關於 GPT-3 的研究提交給科學期刊。現在,沒有人簽名的研究可以發表嗎?

第一個是第一個。 Thunström 詢問 AI 是否願意在期刊上發表這項研究。 GPT-3 的回答是肯定的。此外,如果出於任何原因存在影響出版物真實性的利益衝突。 AI回答沒有。這是否意味著 GPT-3 有情緒,對某些問題很敏感?這正是這個問題的艱難時期。主要是在谷歌工程師與 LaMDA 的談話之後,他說這是一個有感覺的“存在”。根據研究人員的說法,情況並非如此。 LaMDA 也不是,他們從中指出,我們離一個完全明智的實體還很遠。雖然他們還沒有回應 AI 做出肯定回應的原因。

人工智能創造的潘多拉魔盒

長期以來,科學研究期刊一直在關注無關緊要的問題。現在他們增加了關於是否包括人工智能進行的研究的辯論。

“學術出版可能不得不適應人工智能驅動的手稿的未來,如果非敏感的東西可以為他們的一些工作贏得榮譽,人類研究人員的出版記錄的價值可能會發生變化,”Thunström 在一份出版物中指出。

主要是因為許多研究人員已經得出結論,GPT-3 AI 可以走得更遠。他有能力寫出任何向他提議的東西,超出了他的存在所暗示的範圍。正如 Thunström 後來在他自己的調查中所解釋的那樣——這一次是由人類完成的——人工智能製作一篇文章的法律和倫理問題是巨大的。第一個,可能對文本進行更正或修訂的聯繫數據。研究人員解釋說,她必須輸入自己的電話號碼和聯繫電子郵件來克服這個問題。

他們指出,可以“打開潘多拉魔盒”的問題。無論如何,領導這次調查的小組仍在等待了解人工智能創建的文本是否最終會被發布。但他們有希望,而且有一個非常具體的原因。如果科學可以在 24 小時內產生復雜的研究,該行業將不再依賴已發表研究的數量來獲得資金。到頭來,他們一天能生產一個,這將是一個荒謬的事實。

— 這篇文章是從原文自動翻譯過來的 —